Im heutigen digitalen Zeitalter wächst der Bedarf von Unternehmen und Einzelpersonen an effizienten Wissensmanagementsystemen und intelligenten Frage-Antwort-Systemen stetig. Mit der rasanten Entwicklung der künstlichen Intelligenz suchen Menschen nach intelligenteren und effizienteren Lösungen zur Verbesserung der Informationsverarbeitung, Optimierung von Arbeitsabläufen und Verbesserung der Benutzererfahrung.

Casibase hat sich als Open-Source-KI-Wissensdatenbank und Dialogsystem aufgrund seiner leistungsstarken Multi-Modell-Kompatibilität, Enterprise-Level-Funktionen und intuitiven Weboberfläche zur bevorzugten Lösung für viele Entwickler und Unternehmen entwickelt. Es kann nicht nur Wissen effizient organisieren und abrufen, sondern bietet auch flexible Schnittstellen zur einfachen Integration verschiedener KI-Modelle, um unterschiedliche Szenarien zu unterstützen.

Gleichzeitig hat das kürzlich veröffentlichte fortschrittliche KI-Modell DeepSeek R1 aufgrund seiner hervorragenden Leistung, optimierten Destillationstechnologie und kostenlosen Open-Source-Natur große Aufmerksamkeit in der Entwicklergemeinschaft erregt. Die leistungsstarken Schlussfolgerungsfähigkeiten und effiziente Wissensintegration von DeepSeek R1 machen es zu einem wichtigen Mitglied des Open-Source-KI-Ökosystems, das sich in intelligenten Frage-Antwort-Systemen, Codegenerierung, Textverständnis und anderen Aufgaben auszeichnet.

In diesem Artikel werden wir diskutieren, wie man Casibase effizient mit DeepSeek R1 integriert, um ein KI-Wissenssystem und Dialogsystem mit hoher Leistung, Sicherheit und leistungsstarken Funktionen aufzubauen. Wir werden die wichtigsten Schritte von der Umgebungseinrichtung bis zur praktischen Anwendung vorstellen und analysieren, wie man die Enterprise-Level-Funktionen von Casibase und die leistungsstarken Fähigkeiten von DeepSeek R1 nutzt, um präzise und effiziente intelligente Frage-Antwort-Systeme und Wissensmanagement zu realisieren.

Was ist Casibase:

Casibase ist ein Open-Source-KI-Wissenssystem und Dialogsystem, das die neueste RAG-Technologie (Retrieval-Augmented Generation), Enterprise-Level Single Sign-On (SSO) und breite Unterstützung für Mainstream-KI-Modelle kombiniert. Als LangChain-ähnliches System zielt Casibase darauf ab, Unternehmen und Entwicklern eine leistungsstarke, flexible und benutzerfreundliche Plattform für Wissensmanagement und intelligente Dialoge zu bieten.

Derzeit unterstützt Casibase OpenAI-basierte GPT-Serien, Gemini, Claude, Moonshot, DeepSeek und andere Sprachmodelle sowie OpenAI-basierte Embedding-Modelle, Hugging Face's sentence-transformers, Cohere, Qwen und andere Embedding-Modelle. Hugging Face, Cohere, Qwen und andere Einbettungsmodelle. Diese breite Modellunterstützung ermöglicht es Benutzern, die am besten geeigneten KI-Modelle nach ihren Anforderungen und Präferenzen auszuwählen und erleichtert auch die zukünftige Integration neuer Modelle.

Casibase Online-Demo:

Casibase bietet mehrere Online-Demo-Sites, einschließlich Chatbot-Demo und Admin-Interface-Demo, damit Benutzer die Systemfunktionen intuitiv erleben können.

- Chatbot-Demo: https://demo.casibase.com

- Admin-Interface-Demo: https://demo-admin.casibase.com

Integration von Casibase mit DeepSeek-Modellen:

Durch den Aufbau von Casibase und einige einfache Konfigurationen können Sie mit DeepSeek R1, DeepSeek V3 und anderen DeepSeek-Versionen sowie deren erweiterten Versionen auf Plattformen wie Alibaba Cloud kommunizieren. Dies vermeidet die komplexe Konfiguration einer lokalen Bereitstellung.

Schritt 1: Casibase-Umgebungsbereitstellung

1.1 Bereitstellung von Casdoor.

Da die leistungsstarke Enterprise-SSO-Authentifizierung, Authentifizierung und andere Funktionen, die von Casibase bereitgestellt werden, auf Casdoor basieren. Daher ist die Installation von Casdoor eine Voraussetzung für die Nutzung von Casibase.

Casdoor ist ein robustes Authentifizierungssystem, das eine sichere und zuverlässige Anmeldeerfahrung bietet.

Sie können die offizielle Casdoor-Dokumentation zur Fertigstellung der Casdoor-Umgebungsbereitstellung heranziehen: Bereitstellung von Casdoor

1.2 Bereitstellung von Casibase: Bereitstellung von Casibase

Schritt 2: Grundkonfiguration von Casibase

2.1 Casdoor konfigurieren:

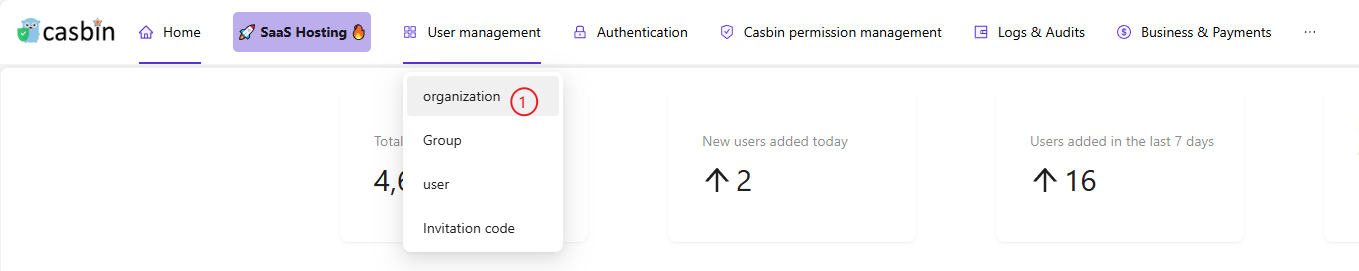

Sie müssen im bereitgestellten Casdoor drei Schritte durchführen, um zu ermöglichen, dass Benutzer auf Casibase zugreifen, nämlich: Organisationen konfigurieren -> Apply konfigurieren unter Authentifizierung -> Benutzer konfigurieren. Führen Sie Folgendes aus:

2.1.1 Organisation hinzufügen

Organisationen auf der Casdoor-Website konfigurieren.

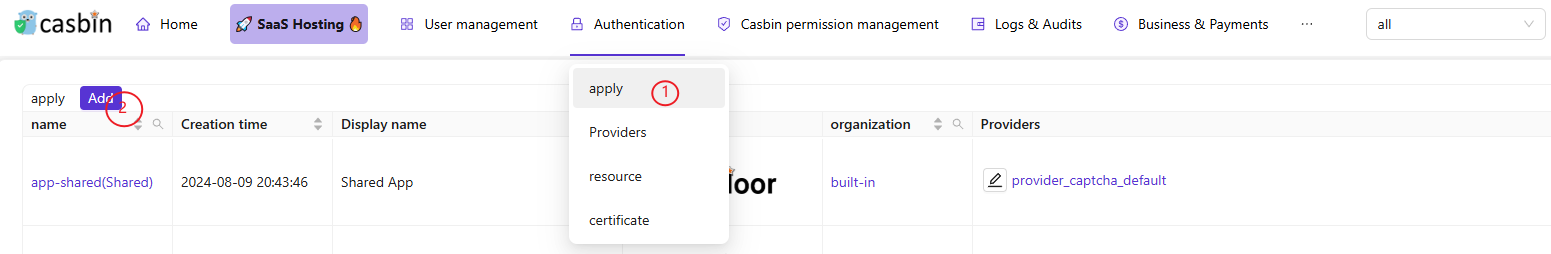

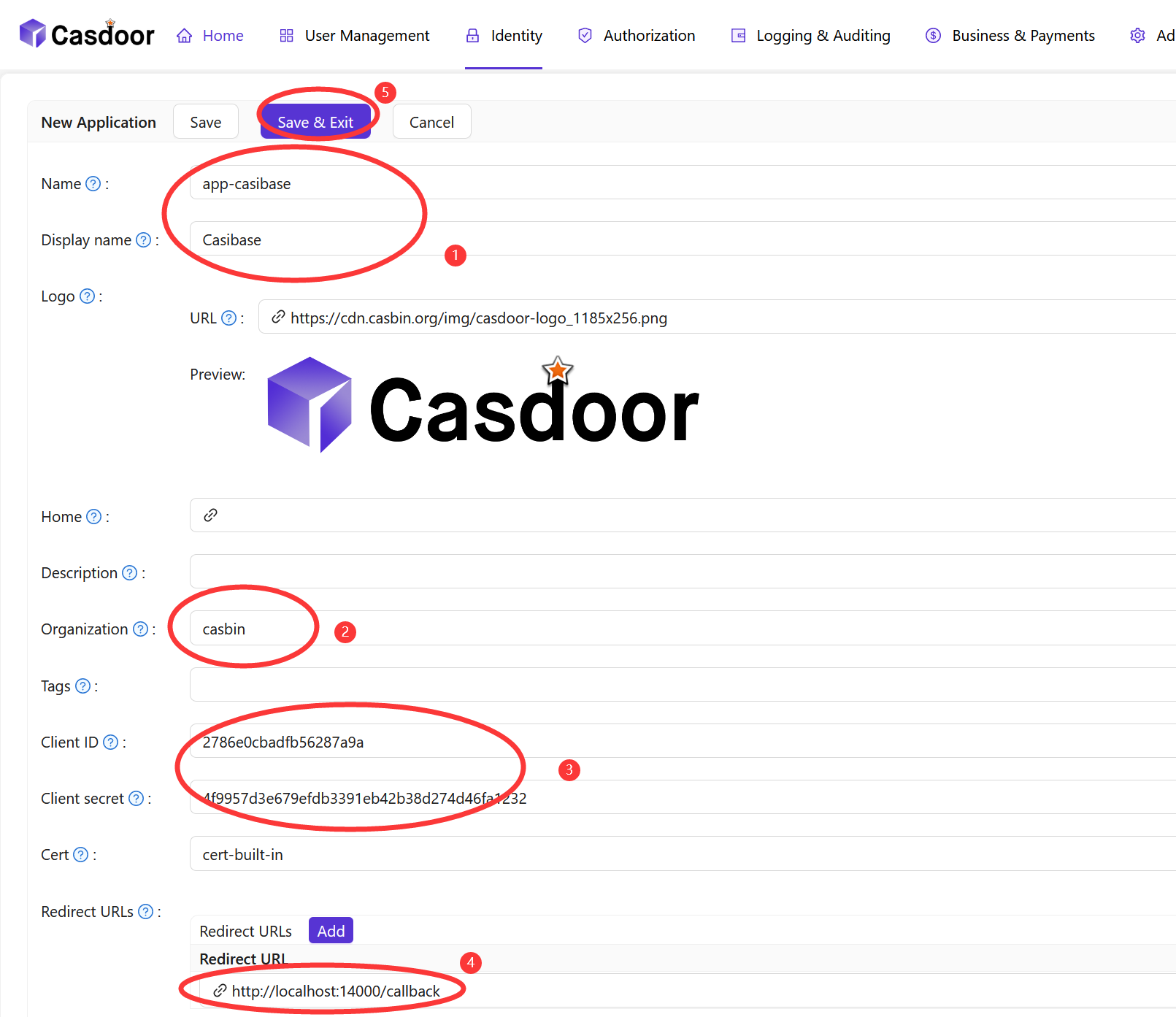

2.1.2 Apply hinzufügen

Legen Sie für Casibase "Anwenden" fest. Sie sollten es basierend auf den von Ihnen konfigurierten Organisationen erstellen, was sich im Formular zum Hinzufügen widerspiegelt.

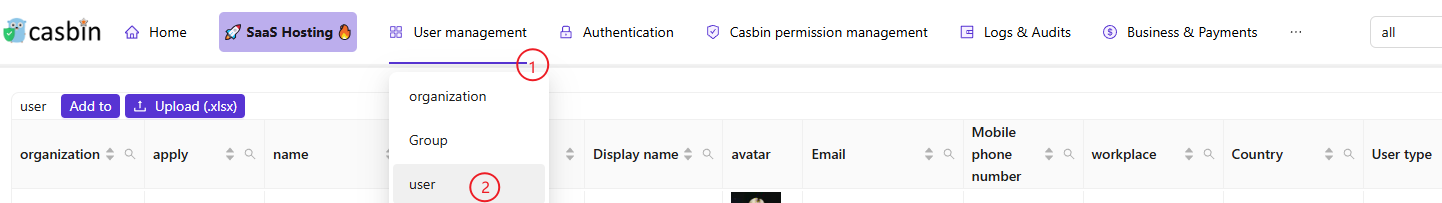

2.1.3 Benutzer hinzufügen

Die Erstellung eines Benutzers für die erstellte Anwendung ist die letzte Vorbereitung für die anschließende Anmeldung bei Casibase. Folgen Sie einfach den Angaben im Formular.

2.2 Casibase konfigurieren:

Mit der obigen Konfiguration haben wir bereits Zugriff auf casibase, als nächstes werden wir es nach dem Einloggen für den AI-Chat konfigurieren, Bereitstellung einer DeepSeek r1 basierend auf der AlibabaCloud Big Model Service Plattform (https://help). liyun.com/zh/model-studio/) unterstütztes Modell.

2.2.1 Speicheranbieter konfigurieren

Erstens ist es notwendig, einen Speicheranbieter zu konfigurieren über Casdoor, der verwendet werden kann, um Daten durch Hinzufügen dieses Speicheranbieters zu speichern. Sie können zur Kasdoor hinzugefügt werden, indem Sie auf die Startseite:Authentication-> Providers->add klicken

2.2.2 Modellanbieter konfigurieren

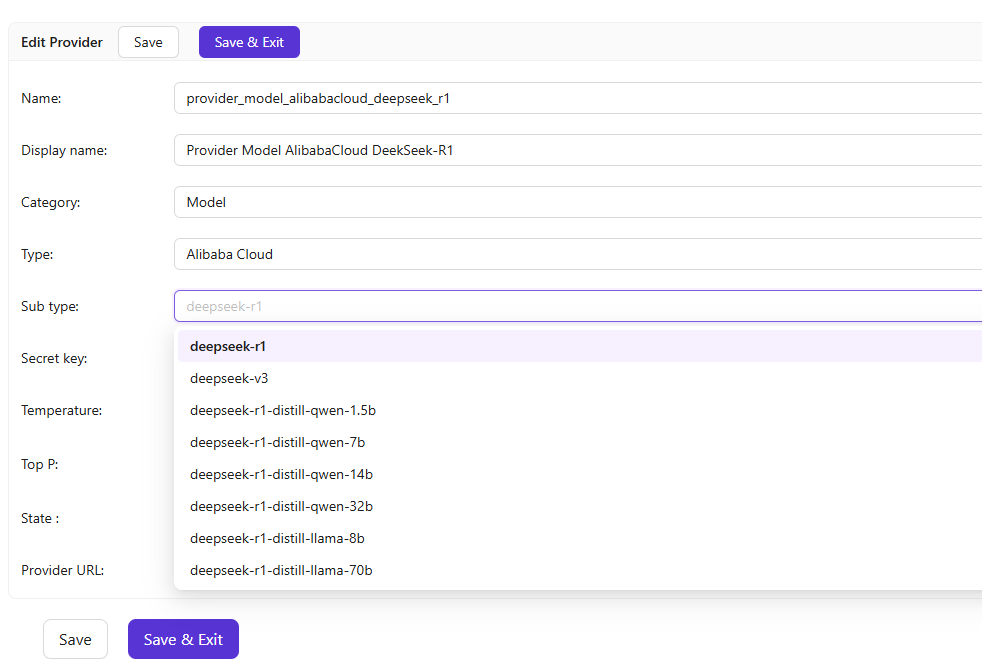

Konfigurieren Sie in Casibase den neuen Modellanbieter: Klicken Sie in der Navigationsleiste oben auf der Homepage->Hinzufügen.

In der Pop-Up-Form können wir Kategorie als Modell festlegen und dann das erste Level-Modell festlegen: Moonshot, DeepSeek, Alibaba Cloud, etc. Hier wählen wir nicht direkt die Unterstützung des KI-Modells aus, die von DeepSeek bereitgestellt wird, sondern verwenden die DeepSeek von der Alibaba Cloud-Unterstützung wie unten gezeigt, können wir verschiedene Untermodelle sehen, die von Alibaba Cloud im Sub-Typ unterstützt werden.

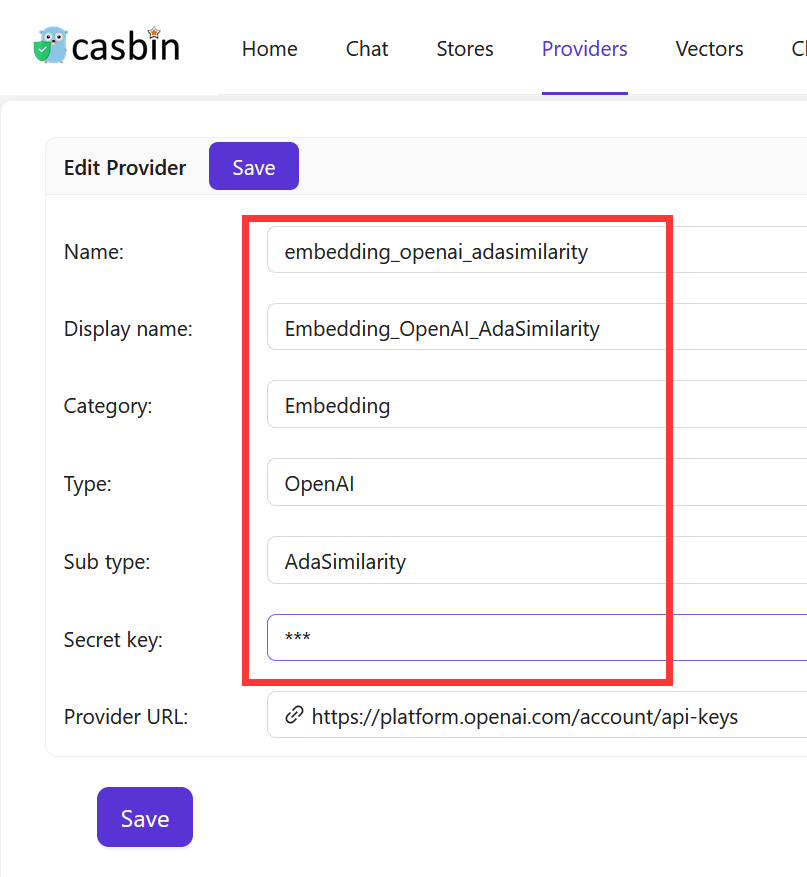

2.2.3 Einbettungsanbieter konfigurieren (Optional)

Nach 2.2.1 und 2.2. wurden erfolgreich hinzugefügt, wir können Einbetting-Anbieter konfigurieren, indem wir Einbetting-Anbieter konfigurieren, können wir mit unserem leistungsstarken Knowledge Base-System Casibase integrieren. Ähnliche Schritte wie 2.2.2, füllen Sie das Formular aus: Authentication-> Providers->add (Bitte beachten Sie, dass die Kategorie als eingebettet konfiguriert werden muss):

2.2.4 Shops hinzufügen.

In diesem Schritt organisieren wir alle Informationen, die wir oben hinzugefügt haben (Speicheranbieter, Modellanbieter, Einbett-Anbieter), in das Formular können wir diese drei Artikel füllen und schließlich erstellen Sie eine Stores.

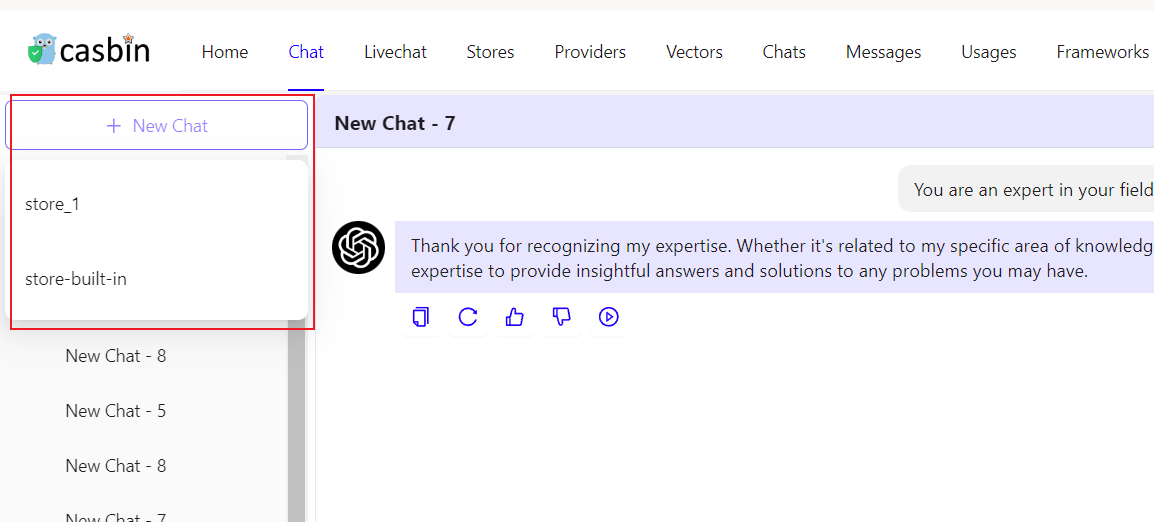

Schritt 3: Chatten mit dem DeepSeek-Modell basierend auf Casibase und Alibaba Cloud

Fazit

In dieser Anleitung haben wir gelernt, wie man die KI-Chat-Funktionalität in Casibase mithilfe von DeepSeek implementiert. Jetzt können Sie mit Chatbots in Casibase chatten.

Weitere Details finden Sie in den Casibase-Dokumenten.